La compañía Anthropic señaló este viernes, 27 de febrero, que no otorgaría al Departamento de Guerra de Estados Unidos el uso militar sin restricciones de su tecnología de inteligencia artificial (IA), a pesar de las presiones del Pentágono.

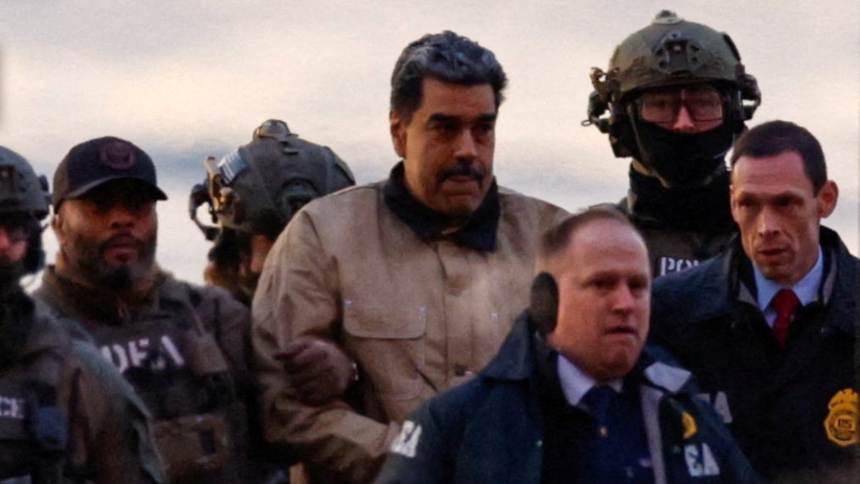

La empresa, cuyo modelo Claude habría sido utilizado en la operación que culminó con la captura de Nicolás Maduro en Caracas, afirmó que no permitirá el uso militar sin restricciones de su tecnología, incluso después de que el gobierno de Donald Trump le diera un ultimátum para aceptar condiciones que violan sus propios lineamientos internos.

LEA TAMBIÉN: LA IA QUE AYUDÓ A ESTADOS UNIDOS A CAPTURAR A NICOLÁS MADURO ‘PIDE‘ EXPLICACIONES AL PENTÁGONO

El director ejecutivo, Dario Amodei, sostuvo que la compañía no puede “en conciencia” acceder a una solicitud que contradice sus principios fundacionales.

«Estas amenazas no cambian nuestra posición: no podemos, en conciencia, acceder a su solicitud», dijo en un comunicado.

El conflicto escaló cuando el Departamento de Defensa amenazó con aplicar la Ley de Producción de Defensa, un instrumento de la Guerra Fría que permite obligar a empresas privadas a priorizar necesidades de seguridad nacional.

Además, el Pentágono advirtió que podría designar a Anthropic como un “riesgo para la cadena de suministro”, una etiqueta normalmente reservada para compañías de países adversarios y que podría dañar gravemente su reputación.

Para una startup que compite en un mercado dominado por gigantes como Google, OpenAI y xAI, el impacto de tal clasificación sería devastador.

OPERACIÓN RESOLUCIÓN ABSOLUTA

La tensión se intensificó tras revelarse que Claude habría sido integrado en sistemas de Palantir durante la operación “Resolución Absoluta”. Se trata del operativo estadounidense del 3 de enero que terminó con la captura de Maduro.

Según reportes citados por The Wall Street Journal, el modelo de Anthropic habría procesado información crítica durante la redada en Caracas.

La empresa asegura que nunca fue informada de este uso específico. Y que, de confirmarse, constituiría una violación directa de sus políticas internas. Las mismas prohíben el empleo de sus modelos en vigilancia masiva o en armas autónomas.

El Pentágono, por su parte, defendió su postura. Su portavoz, Sean Parnell, afirmó que la prioridad del Departamento de Guerra es garantizar que las tropas estadounidenses cuenten con todas las herramientas necesarias para ganar cualquier batalla.

Aunque evitó confirmar detalles operativos sobre el uso de Claude, sí reconoció que la relación con Anthropic está bajo revisión debido a la disputa sobre las políticas de uso.

La administración Trump ha impulsado agresivamente la adopción de IA militar. En ese marco, Anthropic había sido seleccionada para un contrato de hasta 200 millones de dólares.

Mientras tanto, la plataforma militar GenAI.mil continúa integrando modelos de otras compañías. Google y xAI se sumaron en diciembre, y OpenAI anunció recientemente que ChatGPT también estará disponible para aplicaciones militares.